【セミナービデオ】

【DVD(メディア)手数料のお知らせ】

DVDメディアでの納品をご希望の場合、

手数料として商品代プラス1,650円(税込)を加算させていただきます。

収録日 |

2026年1月27日

|

総収録時間 |

220分

|

| ポイント還元 |

誠に勝手ながら2020年4月1日より、会員割引は廃止とさせて頂きます。

当社では会員割引に代わり、会員の方にはポイントを差し上げます。

ポイントは、セミナーや書籍等のご購入時にご利用いただけます。

会員でない方はこちらから会員登録を行ってください。

|

納品方法 |

ダウンロード版をご購入の方は資料およびセミナービデオをダウンロードするためのURLを電子メールにてご案内いたします。

DVDメディアでの納品をご希望の方は別途郵送いたします。

|

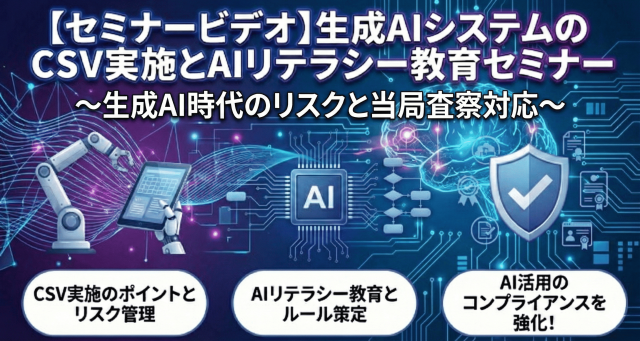

ChatGPT等の生成AIツールが製薬・医療機器業界で急速に普及する中、「CSVの対象なのか」「どうバリデーションするか」という課題に直面しています。本セミナーでは、サムスン電子の情報漏洩事故の教訓を基に、People(AIリテラシー教育)・Process(ルール整備)・Technology(セキュリティ統制)の3層防御体制を解説します。FDA CSA最終ガイダンスに基づく生成AIのバリデーション実践方法、Human in the Loopによる品質保証、査察対応のポイントを具体的に提示し、明日から使える実装ツールとテンプレートを提供します。

はじめに

・生成AIを使用する際の注意事項!

第1部:AIとはさみは使いよう

・「何とかとはさみは使いよう」生成AIも使いよう

・なぜ人はAIに勝てないのか - チェス・将棋・囲碁から学ぶ教訓

・AIのIQは120~136程度で人類平均の100を超えている

・生成AIではこんなことも出来ます ~その1~

・生成AIではこんなことも出来ます ~その2~

・生成AIではこんなことも出来ます ~その3~

・生成AIではこんなことも出来ます ~その4~

・生成AIではこんなことも出来ます ~その5~

・AIへの投資は未来への投資

・生成AIは「魔法の杖」ではなく「優秀なアシスタント」

・AIは副操縦士(Co-Pilot)

・如何に生成AIを使いこなすか

・生成AI時代における学習の変革

・医療機器・製薬業界における生成AIの必要性

・生成AI利用のチェックリスト

第2部:生成AIの基礎知識

・大規模言語モデル(LLM)とは

・生成AIとは何か

・GPT(Generative Pre-trained Transformer)とは

・生成AI(ジェネレーティブAI)とは

・生成AIの基本的な仕組み

・ファインチューニングとは

・各種生成AIツールの特性と使い分け

・AI生成コンテンツの特性

・生成AI使用上の注意点

・ハルシネーション(hallucination)

第3部:ハルシネーションの低減方法

・ハルシネーションの低減方法

・ハルシネーション(幻覚)という現象

・ハルシネーション(幻覚)の問題

・2025年の主要な知見

・ハルシネーション (Hallucination)

・ハルシネーションの低減方法

・生成AIではこんなことも出来ます ~その6~

第4部:RAGについて

・RAG(Retrieval-Augmented Generation)アプローチによる精度向上

・RAGの基本概念と最新動向

・従来のAIとの違い

・生成AIではこんなことも出来ます ~その7~

第5部:データインテグリティとバリデーション

・AI規制動向の認識

・CSV(コンピュータ化システムバリデーション)の基礎

・今後のCSV活用範囲の拡大

・2025年9月発出のFDA CSAガイダンスの重要ポイント

・CSAと従来型CSVの違いと実装例

・2025年9月発出のFDA CSAガイダンスの重要ポイント

・データインテグリティの確保

・バリデーションの考慮事項

・FDA/PMDA査察官が生成AI使用時に確認する重点項目

・指摘事例とWarning Letter分析(仮想)

・今後予想されるFDA/PMDA査察実施方法(2026~2028年)

・効果的な査察対応方法:ベストプラクティス

・査察準備チェックリスト:3ヶ月前から実施

・査察後の対応

第6部:Human in the Loopの重要性

・人間の監督(Human Oversight)

・HUMAN in the Loopの重要性

・Human in the Loopが重要な理由

・AIの使いこなし方:機長と副操縦士の関係

・AIによる作成物のレビュープロセス

・バリデーションの考慮事項

・規制当局の動向

・人間がより注力すべきこと

第7部:導入時の考慮事項

・生成AI時代の課題と問題点①

・生成AI時代の課題と問題点②

・生成AI時代の課題と問題点③

・生成AI時代の課題と問題点④

・導入ロードマップ

第8部:なぜ生成AIセキュリティが重要なのか

・なぜ今、生成AIセキュリティが重要なのか

・セキュリティインシデント事例 他社の失敗から学ぶ

・包括的セキュリティソリューション:多層防御アプローチ

第9部:ChatGPT Enterpriseの可能性

・ChatGPT Enterprise版の決定的優位性

・管理機能の充実

・Enterprise版の深刻な利用実態

・セッション管理と記憶の構造的問題

・プロンプト設計の属人化という深刻な組織課題

・利用中止の実態とセキュリティ懸念

・利用目的の不明確さと業務適合性の根本的問題

・回答精度への不満と期待とのギャップ

・教育体制の不備とリテラシー格差

第10部:実践的なツールの活用方法

・主要なAI検索ツールの特徴(2025年11月版)

・各ツールの価格比較(2025年11月現在)

・効果的な検索とファクトチェックの方法

・検索系AIと生成系AIの使い分け

第11部:今後の展望と規制対応

・規制当局の動向

・導入ロードマップ:段階的アプローチ

・生成AI時代の課題

・成功への提言

・AIと専門家による規制対応の強化

第12部:技術的品質管理面

・1. AI出力の正確性検証とファクトチェックの方法論

・1.1 なぜ正確性検証が必要なのか?

・1.2 ファクトチェックの3段階アプローチ

・医療機器・製薬業界における生成AIの必要性

・1.3 実践的チェックリスト

・1.4 具体例:医薬品情報のファクトチェック

・2. 情報源の信頼性評価能力と批判的分析

・2.1 情報源の信頼性評価フレームワーク

・2.2 情報源の階層(エビデンスレベル)

・2.3 批判的分析の実践

・2.4 バイアス検出のチェックリスト

・3. AI利用の明示と検証プロセスの透明性確保

・3.1 なぜ透明性が重要なのか?

・3.2 AI利用明示の3つのレベル

・3.3 業界別の透明性要件

・4. AI生成であることの明示方法と文書管理

・4.1 文書分類とラベリング

・4.2 ファイル命名規則の例

・4.3 メタデータ管理

・4.4 バージョン管理のベストプラクティス

・5. データ品質とバイアスの認識・評価

・5.1 AIにおけるデータ品質の5次元

・5.2 バイアスの種類と影響

・5.3 バイアス検出のチェックリスト

・5.4 バイアス軽減のための実践的手法

・6. バージョン管理と再現性の確保

・6.1 なぜ再現性が重要なのか?

・6.2 AI利用における再現性の課題

・6.3 再現性確保のための記録項目

・6.4 プロンプト管理のベストプラクティス

・7. 温度パラメータ等のハイパーパラメータの理解

・7.1 主要なハイパーパラメータ

・7.2 用途別の推奨パラメータ設定

・7.3 実験的アプローチ

・8. 出力の評価指標の基本理解

・8.1 定性的評価指標

・8.2 定量的評価指標(必要に応じて)

・8.3 実務での簡易評価フレームワーク

・9. 医療機器・製薬業界における特殊要件

・9.1 GxP適合性とAI利用

・9.2 データインテグリティ(ALCOA+原則)

・9.3 21 CFR Part 11準拠

・21 CFR Part 11対応チェックリスト

・9.4 FDA AI/ML医療機器ガイダンス対応

・9.5 医療機器特有のAIファクトチェック例

・9.6 業界別AI利用ポリシー例

・10. 実践演習

・11. チェックリスト:日常業務での品質管理

・12. まとめ

・13. 次のステップ

第13部:倫理的法的側面

・1. なぜ倫理的・法的側面が重要なのか?

・1.1 基本的な考え方

・1.2 主なリスク領域

・2. 著作権・知的財産権【最新動向反映】

・2.1 基本的な理解

・2.2 日本における著作権法の考え方

・2.3 AI生成物の著作権【2024年時点の最新認識】

・2.4 国際的な動向の比較【2024年12月最新版】

・2.5 EU AI Act における著作権保護規定

・2.6 実践的なチェックリスト

・3. 国際的なAI規制の動向【2024年施行状況反映】

・3.1 主要な規制フレームワーク

・3.1.1 EU AI Act(2024年5月発効)【詳細版】

・3.1.2 米国:Executive Order on AI(2023年)+ 2024年の動向

・3.1.3 日本:AI戦略とガイドライン【2024年版】

・3.2 規制対応のための実践ステップ

・4. プライバシー保護とデータセキュリティ

・4.1 なぜAI利用でプライバシーが問題になるのか?

・4.2 適用される法規制

・4.2.1 GDPR(EU一般データ保護規則)

・4.2.2 日本:個人情報保護法【2024年全面施行版】

・4.3 実践的なデータ保護対策

・4.4 チェックリスト:データ保護

・5. 生成AIサービスの利用規約【2024年12月版】

・5.1 なぜ利用規約が重要なのか?

・5.2 主要サービスの利用規約比較【最新版】

・5.3 2024年の重要な変更点

・ChatGPT(OpenAI)の動向

・Claude(Anthropic)の動向

・Gemini(Google)の動向

・5.4 利用規約確認のポイント

・5.5 社内利用ガイドライン策定のポイント

・6. AI利用における倫理的配慮と社会的責任

・6.1 なぜ倫理的配慮が必要なのか?

・6.2.1 国際的な倫理原則の比較

・6.2.2 日本の倫理ガイドライン

・6.3 実践的な倫理判断のフレームワーク

・6.4 倫理的ジレンマへの対応

・7. 透明性と説明責任(Accountability)

・7.1 透明性とは何か?

・7.2 説明責任(Accountability)とは何か?

・7.3 透明性確保の実践方法

・7.3.1 AI利用の明示方法

・7.3.2 医療機器・製薬業界での透明性要件

・7.3.3 文書化すべき情報

・7.4 説明責任の体制構築

・8. 公平性とバイアス軽減

・8.1 AIバイアスとは?

・8.2 バイアスの具体例

・8.3 バイアス軽減のための実践

・8.3.1 バイアス検出の方法

・8.3.2 バイアス軽減の技法

・8.3.3 バイアステストの実装例

・9. 医療機器・製薬業界における特殊要件

・9.1 なぜ医療機器・製薬業界は特殊なのか?

・9.2 規制フレームワークとの関係

・9.2.1 EU AI Act における医療機器

・9.2.2 FDA AI/ML医療機器ガイダンス

・9.2.3 PMDA(日本)のAI医療機器規制

・9.3 GxP遵守とAI利用

・9.3.1 GMP(医薬品製造管理基準)

・9.3.2 GCP(医薬品臨床試験基準)

・9.3.3 GVP(医薬品安全性監視基準)

・9.4 バリデーションとベリフィケーション

・9.5 医療機器サイバーセキュリティ

・9.6 規制当局対応

・9.6.1 承認申請資料へのAI利用の記載

・9.6.2 照会事項への回答準備

・9.7 医療AI倫理委員会の設置

・10. まとめ:倫理的・法的に適切なAI利用のために

・10.1 重要ポイントの振り返り

・10.2 実践のための行動計画

・10.3 チェックリスト:倫理的・法的に適切なAI利用

・10.4 医療機器・製薬業界の特別チェックリスト

・11. 参考資料とさらなる学習

・11.1 公式ガイドライン・規制文書

・11.2 継続的な学習のために

・12. よくある質問(FAQ)【2024年版】

・おわりに

・付録A:クイックレファレンスカード

・付録B:医療機器・製薬業界専用チェックリスト